Correlación

En probabilidad y estadística, la correlación indica la fuerza y la dirección de una relación lineal y la proporcionalidad entre dos variables estadísticas. Se considera que dos variables cuantitativas están correlacionadas cuando los valores de una de ellas varían sistemáticamente con respecto a los valores homónimos de la otra: si tenemos dos variables (A y B) existe correlación entre ellas si al disminuir los valores de A lo hacen también los de B y viceversa. La correlación entre dos variables no implica, por sí misma, ninguna relación de causalidad (Véase cum hoc ergo propter hoc). Por ejemplo, los ingresos y gastos de una familia, la producción y ventas de una fábrica, los gastos en publicidad y beneficios de una empresa.

Una relación funcional se expresa mediante una función matemática. Si X es la variable independiente e Y es la variable dependiente, una relación funcional tiene la forma: pY=f(X)

Las correlaciones son útiles porque pueden indicar una relación predictiva que puede explotarse en la práctica. Por ejemplo, una compañía eléctrica puede producir menos electricidad en un día templado basándose en la correlación entre la demanda de electricidad y el tiempo. En este ejemplo, existe una relación causal, porque el tiempo extremo hace que la gente utilice más electricidad para calefacción o refrigeración. Sin embargo, en general, la presencia de una correlación no es suficiente para inferir la presencia de una relación causal (es decir, correlación no implica causalidad).

Formalmente, las variables aleatorias son dependientes si no satisfacen una propiedad matemática de independencia probabilística. En lenguaje informal, correlación es sinónimo de dependencia. Sin embargo, cuando se utiliza en un sentido técnico, la correlación se refiere a cualquiera de varios tipos específicos de operaciones matemáticas entre las variables probadas y sus respectivos valores esperados. Esencialmente, la correlación es la medida de cómo dos o más variables están relacionadas entre sí. Existen varios coeficientes de correlación, a menudo denotados o , que miden el grado de correlación. El más común de ellos es el Coeficiente de correlación de Pearson, que sólo es sensible a una relación lineal entre dos variables (que puede estar presente incluso cuando una variable es una función no lineal de la otra). Otros coeficientes de correlación - como el correlación de rangos de Spearman - se han desarrollado para ser más robustos que el de Pearson, es decir, más sensibles a las relaciones no lineales.[1][2][3] Información mutua también puede aplicarse para medir la dependencia entre dos variables.

Coeficiente producto-momento de Pearson[editar]

La medida más conocida de la dependencia entre dos magnitudes es el coeficiente de correlación producto-momento de Pearson (CCMPP), o "coeficiente de correlación de Pearson", comúnmente llamado simplemente "coeficiente de correlación". Se obtiene tomando el cociente de la covarianza de las dos variables en cuestión de nuestro conjunto de datos numéricos, normalizado a la raíz cuadrada de sus varianzas. Matemáticamente, basta con dividir la covarianza de las dos variables por el producto de sus desviación típica. Karl Pearson desarrolló el coeficiente a partir de una idea similar pero ligeramente diferente de Francis Galton.[4]

Un coeficiente de correlación producto-momento de Pearson intenta establecer una línea de mejor ajuste a través de un conjunto de datos de dos variables mediante el trazado esencialmente de los valores esperados y el coeficiente de correlación de Pearson resultante indica lo lejos que está el conjunto de datos real de los valores esperados. Dependiendo del signo de nuestro coeficiente de correlación de Pearson, podemos acabar con una correlación negativa o positiva si existe algún tipo de relación entre las variables de nuestro conjunto de datos.

El coeficiente de correlación poblacional entre dos variables aleatorias y con valor esperado y con valor esperados y y desviación típicas y se define como:

donde es el operador valor esperado, significa covarianza, y es una notación alternativa ampliamente utilizada para el coeficiente de correlación. La correlación de Pearson sólo se define si ambas desviaciones típicas son finitas y positivas. Una fórmula alternativa puramente en términos de momentos es:

Correlación e independencia[editar]

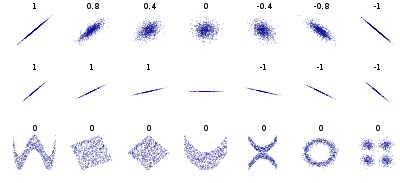

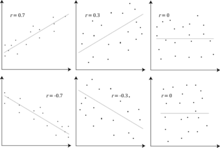

Es un corolario de la desigualdad de Cauchy-Schwarz que el valor absoluto del coeficiente de correlación de Pearson no es mayor que 1. Por lo tanto, el valor de un coeficiente de correlación oscila entre -1 y +1. El coeficiente de correlación es +1 en el caso de una relación lineal directa (creciente) perfecta (correlación), -1 en el caso de una relación lineal inversa (decreciente) perfecta (anticorrelación),[5] y algún valor en el intervalo abierto en todos los demás casos, indicando el grado de dependencia lineal entre las variables. A medida que se acerca a cero hay menos relación (más cerca de la no correlación). Cuanto más se acerque el coeficiente a −1 o 1, más fuerte será la correlación entre las variables.

Si las variables son independientes, el coeficiente de correlación de Pearson es 0, pero lo contrario no es cierto porque el coeficiente de correlación sólo detecta dependencias lineales entre dos variables.

Por ejemplo, supongamos que la variable aleatoria se distribuye simétricamente alrededor de cero, y . Entonces está completamente determinada por , de modo que y son perfectamente dependientes, pero su correlación es cero; están no correlacionadas. Sin embargo, en el caso especial de que y sean distribuciones normales multivariadas, la falta de correlación es equivalente a la independencia.

Aunque los datos no correlacionados no implican necesariamente independencia, se puede comprobar si las variables aleatorias son independientes si su información mutua es 0.

Fuerza, sentido y forma de la correlación[editar]

Si representamos cada par de valores como las coordenadas de un punto, el conjunto de todos ellos se llama nube de puntos o diagrama de dispersión. La relación entre dos variables cuantitativas queda representada mediante la línea de mejor ajuste, trazada a partir de la nube de puntos. Los principales componentes elementales de una línea de ajuste y, por lo tanto, de una correlación, son la fuerza, el sentido y la forma:

- La fuerza extrema según el caso, mide el grado en que la línea representa a la nube de puntos: si la nube es estrecha y alargada, se representa por una línea recta, lo que indica que la relación es fuerte; si la nube de puntos tiene una tendencia elíptica o circular, la relación es débil.

- El sentido mide la variación de los valores de B con respecto a A: si al crecer los valores de A lo hacen los de B, la relación es directa (pendiente positiva); si al crecer los valores de A disminuyen los de B, la relación es inversa (pendiente negativa).

- La forma establece el tipo de línea que define el mejor ajuste: la línea recta, la curva monotónica o la curva no monotónica

Coeficientes de correlación[editar]

Existen diversos coeficientes que miden el grado de correlación, adaptados a la naturaleza de los datos. El más conocido es el coeficiente de correlación de Pearson (introducido en realidad por Francis Galton), que se obtiene dividiendo la covarianza de dos variables entre el producto de sus desviaciones estándar. Otros coeficientes son:

Interpretación geométrica[editar]

Dados los valores muestrales de dos variables aleatorias e , que pueden ser consideradas como vectores en un espacio de n dimensiones, pueden construirse los "vectores centrados" como:

e .

El coseno del ángulo alfa entre estos vectores es dado por la fórmula siguiente:

Pues es el coeficiente de correlación muestral de Pearson. El coeficiente de correlación es el coseno del ángulo entre ambos vectores centrados:

- Si r = 1, el ángulo °, ambos vectores son colineales (paralelos).

- Si r = 0, el ángulo °, ambos vectores son ortogonales.

- Si r =-1, el ángulo °, ambos vectores son colineales de dirección opuesto.

Más generalmente: .

Por supuesto, desde el punto vista geométrico, no hablamos de correlación lineal: el coeficiente de correlación tiene siempre un sentido, cualquiera sea su valor entre -1 y 1. Nos informa de modo preciso, no tanto sobre el grado de dependencia entre las variables, sino sobre su distancia angular en la hiperesfera de n dimensiones.

La Iconografía de las correlaciones es un método de análisis multidimensional que reposa en esta idea. La correlación lineal se da cuando en una nube de puntos se encuentran o se distribuyen alrededor de una recta.

La fórmula de correlación para dos series distintas con cierto desfase "k", está dada por la fórmula:

Distribución del coeficiente de correlación[editar]

El coeficiente de correlación muestral o analítico de una muestra es de hecho una variable aleatoria, eso significa que si repetimos un experimento o consideramos diferentes muestras se obtendrán valores diferentes y por tanto el coeficiente de correlación muestral calculado a partir de ellas tendrá valores ligeramente diferentes. Para muestras grandes la variación en dicho coeficiente será menor que para muestras pequeñas. R. A. Fisher fue el primero en determinar la distribución de probabilidad para el coeficiente de correlación.

Si las dos variables aleatorias que trata de relacionarse proceden de una distribución gaussiana bivariante entonces el coeficiente de correlación r sigue una distribución de probabilidad dada por:[6][7]

donde:

- es la distribución gamma

- es la función gaussiana hipergeométrica.

Nótese que el valor esperado del coeficiente de correlación muestral r es:

por tanto, r es estimador sesgado de . Puede obtenerse un estimador aproximado no sesgado resolviendo la ecuación:

para

Aunque, la solución:

es subóptima. Se puede obtener un estimador sesgado con mínima varianza para grandes valores de n, con sesgo de orden buscando el máximo de la expresión:

, i.e.

En el caso especial de que , la distribución original puede ser reescrita como:

donde es la función beta.

Distribución normal bivariada[editar]

Si un par de de variables aleatorias sigue una distribución normal bivariada, la media condicional es una función lineal de , y la media condicional es una función lineal de . El coeficiente de correlación entre y , junto con las medias y varianzas marginales de y , determina esta relación lineal:

deonde y son los valores esperados de y , respectivamente, y y son las desviaciones estándar de y , respectivamente.

La correlación empírica es una estimación del coeficiente de correlación . Una estimación de distribución para es dado por

Referencias[editar]

- ↑ Croxton, Frederick Emory; Cowden, Dudley Johnstone; Klein, Sidney (1968) Applied General Statistics, Pitman. ISBN 9780273403159 (página 625)

- ↑ Dietrich, Cornelius Frank (1991) Uncertainty, Calibration and Probability: La Estadística de la Medición Científica e Industrial 2ª Edición, A. Higler. ISBN 9780750300605 (Página 331)

- ↑ Aitken, Alexander Craig (1957) Statistical Mathematics 8ª Edición. Oliver & Boyd. ISBN 9780050013007 (Página 95)

- ↑ Rodgers, J. L.; Nicewander, W. A. (1988). «Trece formas de ver el coeficiente de correlación». The American Statistician 42 (1): 59-66. JSTOR 2685263. doi:10.1080/00031305.1988.10475524.

- ↑ Dowdy, S. y Wearden, S. (1983). "Estadística para la investigación", Wiley. ISBN 0-471-08602-9 pp 230

- ↑ Kenney, J. F. and Keeping, E. S., Mathematics of Statistics, Pt. 2, 2nd ed. Princeton, NJ: Van Nostrand, 1951.

- ↑ Correlation Coefficient - Bivariate Normal Distribution

- ↑ Taraldsen, Gunnar (2021). «The Confidence Density for Correlation». Sankhya A (en inglés). ISSN 0976-8378. S2CID 244594067. doi:10.1007/s13171-021-00267-y.

- ↑ Taraldsen, Gunnar (2020). Confidence in Correlation (en inglés). doi:10.13140/RG.2.2.23673.49769.

Para más información[editar]

- Cohen, J.; Cohen P.; West, S.G.; Aiken, L.S. (2002). Applied multiple regression/correlation analysis for the behavioral sciences (3rd edición). Psychology Press. ISBN 978-0-8058-2223-6.

- Hazewinkel, Michiel, ed. (2001), «Correlación», Encyclopaedia of Mathematics (en inglés), Springer, ISBN 978-1556080104.

- Oestreicher, J. & D. R. (26 de febrero de 2015). Plague of Equals: A science thriller of international disease, politics and drug discovery. California: Omega Cat Press. p. 408. ISBN 978-0963175540.

Enlaces externos[editar]

Wikcionario tiene definiciones y otra información sobre correlación.

Wikcionario tiene definiciones y otra información sobre correlación.- Diccionario Estadístico - Divestadística (en castellano)

- [1] (enlace roto disponible en Internet Archive; véase el historial, la primera versión y la última). Simulación de la correlación entre dos variables discretas con R (lenguaje de programación)

- MathWorld page on the (cross-)correlation coefficient/s of a sample

- Compute significance between two correlations, for the comparison of two correlation values.

- «A MATLAB Toolbox for computing Weighted Correlation Coefficients». Archivado desde el original el 24 de abril de 2021.

- Proof that the Sample Bivariate Correlation has limits plus or minus 1

- Interactive Flash simulation on the correlation of two normally distributed variables by Juha Puranen.

- Correlation analysis. Biomedical Statistics

- R-Psychologist Correlation visualization of correlation between two numeric variables

![{\displaystyle \rho _{X,Y}=\operatorname {corr} (X,Y)={\operatorname {cov} (X,Y) \over \sigma _{X}\sigma _{Y}}={\operatorname {E} [(X-\mu _{X})(Y-\mu _{Y})] \over \sigma _{X}\sigma _{Y}},\quad {\text{if}}\ \sigma _{X}\sigma _{Y}>0.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b551ad29592ae746bf05fe397fbdc56201f483a5)

![{\displaystyle {\rho }=r\left[1+{\frac {1-r^{2}}{2\left(n-1\right)}}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0d68c13b73ae863f666afd6373404c4d94832b72)

![{\displaystyle {\hat {\rho }}=r\left[1-{\frac {1-r^{2}}{2\left(n-1\right)}}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ca0d8412be5001c355ee56bce88d2fe2fbb7f997)