Teoría de la probabilidad

La teoría de la probabilidad es una rama de las matemáticas que estudia los fenómenos aleatorios y estocásticos. Los fenómenos aleatorios se contraponen a los fenómenos deterministas, los cuales son resultados únicos y/o previsibles de experimentos realizados bajo las mismas condiciones determinadas, por ejemplo, si se calienta agua a 100 °C a nivel del mar se obtendrá vapor. Los fenómenos aleatorios, por el contrario, son aquellos que se obtienen de experimentos realizados, otra vez, bajo las mismas condiciones determinadas pero como resultado posible poseen un conjunto de alternativas, por ejemplo, el lanzamiento de un dado o de una moneda.

La teoría de probabilidades se ocupa de asignar un cierto número a cada posible resultado que pueda ocurrir en un experimento aleatorio, con el fin de cuantificar dichos resultados y saber si un suceso es más probable que otro.

Muchos fenómenos naturales son aleatorios, pero existen algunos como el lanzamiento de un dado, donde el fenómeno no se repite en las mismas condiciones, debido a que las características del material hace que no exista una simetría del mismo, así las repeticiones no garantizan una probabilidad definida. En los procesos reales que se modelizan mediante distribuciones de probabilidad corresponden a modelos complejos donde no se conocen a priori todos los parámetros que intervienen; ésta es una de las razones por las cuales la estadística, que busca determinar estos parámetros, no se reduce inmediatamente a la teoría de la probabilidad en sí.

En 1933, el matemático soviético Andréi Kolmogórov propuso un sistema de axiomas para la teoría de la probabilidad, basado en la teoría de conjuntos y en la teoría de la medida, desarrollada pocos años antes por Lebesgue, Borel y Frechet entre otros.

Esta aproximación axiomática que generaliza el marco clásico de la probabilidad, la cual obedece a la regla de cálculo de casos favorables sobre casos posibles, permitió la rigorización de muchos argumentos ya utilizados, así como el estudio de problemas fuera de los marcos clásicos. Actualmente, la teoría de la probabilidad encuentra aplicación en las más variadas ramas del conocimiento, como puede ser la física (donde corresponde mencionar el desarrollo de las difusiones y el movimiento Browniano), o la economía (donde destaca el modelo de Black-Scholes para la valoración de activos financieros).

Como fundamento matemático de la estadística, la teoría de la probabilidad es esencial para muchas actividades humanas que implican el análisis cuantitativo de datos.[1] Los métodos de la teoría de la probabilidad también se aplican a las descripciones de sistemas complejos dado sólo un conocimiento parcial de su estado, como en la mecánica estadística o la estimación secuencial. Un gran descubrimiento de la física del siglo XX fue la naturaleza probabilística de los fenómenos físicos a escalas atómicas, descrita en la mecánica cuántica.[2]

Definición de probabilidad[editar]

Historia[editar]

Inicialmente, la teoría de la probabilidad consideraba principalmente sucesos discretos, y sus métodos eran principalmente combinatoria. Con el tiempo, las consideraciones del analítico obligaron a incorporar variables continuas a la teoría.

Esto culminó en la moderna teoría de la probabilidad, sobre las bases sentadas por Andrey Nikolaevich Kolmogorov. Kolmogorov combinó la noción de espacio muestral, introducida por Richard von Mises, y la teoría de la medida y presentó su sistema de axiomas de Kolmogorov para la teoría de la probabilidad en 1933. Esto se convirtió en la mayor parte indiscutible base axiomática para la teoría moderna de la probabilidad; pero, existen alternativas, como la adopción de aditividad finita en lugar de contable por Bruno de Finetti.[3] La teoría de la probabilidad se desarrolló originalmente a partir de ciertos problemas planteados en el contexto de juegos de azar. Inicialmente, no existía una teoría axiomática bien definida y las definiciones iniciales de probabilidad se basaron en la idea intuitiva de un cociente de ocurrencias:

(1)

donde A es un suceso cualquiera y:

- es el número de veces que se ha repetido una acción u observación cuyo resultado puede dar el suceso A o no-A.

- es el número de veces que observa A en todas las observaciones.

Este tipo de definiciones si bien permitieron desarrollar un gran número de propiedades, no permitían deducir todos los teoremas y resultados importantes que hoy forman parte de la teoría de la probabilidad. De hecho el resultado anterior se puede demostrar rigurosamente dentro del enfoque axiomático de la teoría de la probabilidad, bajo ciertas condiciones.

La moderna teoría matemática de la probabilidad tiene sus raíces en los intentos de analizar juegos de azar por Gerolamo Cardano en el siglo XVI, y por Pierre de Fermat y Blaise Pascal en el siglo XVII (por ejemplo el "problema de los puntos").[4] Christiaan Huygens publicó un libro sobre el tema en 1657.[5] En el siglo XIX, lo que se considera la definición clásica de probabilidad fue completada por Pierre Laplace.[6]

La primera axiomatización completa se debió a Andréi Kolmogórov (quien usó dicho enfoque por ejemplo para deducir su "ley 0-1 para sucesos cola" y otros resultados relacionados con la convergencia de sucesiones aleatorias). La definición axiomática de la probabilidad se basa en resultados de la teoría de la medida y en formalizaciones de la idea de independencia probabilística. En este enfoque se parte de un espacio de medida normalizada donde es un conjunto llamado espacio de sucesos (según el tipo de problema puede ser un conjunto finito, numerable o no-numerable), es una σ-álgebra de subconjuntos de y es una medida normalizada (es decir, ). Los sucesos posibles se consideran como subconjuntos S de eventos elementales posibles: y la probabilidad de cada suceso viene dada por la medida de dicho conjunto:

,

La interpretación de esta probabilidad es la frecuencia promedio con la que aparece dicho suceso si se considera una elección de muestras aleatorias sobre .

La definición anterior es complicada de representar matemáticamente ya que debiera ser infinito. Otra manera de definir la probabilidad es de forma axiomática esto estableciendo las relaciones o propiedades que existen entre los conceptos y operaciones que la componen.

Definición clásica de probabilidad[editar]

La probabilidad es la característica de un evento, que hace que existan razones para creer que este se realizará.

La probabilidad p de que suceda un evento S de un total de n casos posibles igualmente probables es igual a la razón entre el número de ocurrencias h de dicho evento (casos favorables) y el número total de casos posibles n.

La probabilidad es un número (valor) que varia entre 0 y 1. Cuando el evento es imposible se dice que su probabilidad es 0, si el evento es cierto y siempre tiene que ocurrir su probabilidad es 1.

La probabilidad de no ocurrencia de un evento está dada por q, donde:

Sabemos que p es la probabilidad de que ocurra un evento y q es la probabilidad de que no ocurra, entonces p + q = 1

Simbólicamente el espacio de resultados, que normalmente se denota por , es el espacio que consiste en todos los resultados que son posibles. Los resultados, que se denota por , etcétera, son elementos del espacio .

Definición axiomática[editar]

Como se ha adelantado anteriormente la definición axiomática de probabilidad es una extensión de la teoría de la medida, en la que se introducen la noción de independencia relativa. Este enfoque permite reproducir los resultados de la teoría clásica de la probabilidad además de resultados nuevos referidos a la convergencia de variables aleatorias. Además de los procesos estocásticos, el cálculo de Itô y las ecuaciones diferenciales estocásticas.

Dentro del enfoque axiomático es posible demostrar que la ley débil de los grandes números implica que se cumplirá que:

Esto permite justificar rigurosamente la ecuación () suponiendo que:

Donde se interpreta con probabilidad p y que con proabilidad 1-p.

Definición moderna[editar]

Comienza con un conjunto infinito o contable llamado espacio muestral, que se relaciona con el conjunto de todos los resultados posibles en sentido clásico, denotado por . Se supone entonces que para cada elemento , se adjunta un valor intrínseco de "probabilidad" , que satisface las siguientes propiedades:

Es decir, la función de probabilidad f(x) está entre cero y uno para cada valor de x en el espacio muestral Ω, y la suma de f(x) sobre todos los valores x en el espacio muestral Ω es igual a 1. Un event se define como cualquier subconjunto del espacio muestral . La probabilidad del suceso se define como

Así, la probabilidad de todo el espacio muestral es 1, y la probabilidad del suceso nulo es 0.

La función que asigna un punto del espacio muestral al valor de "probabilidad" se denomina «función de masa de probabilidad,» abreviada como «pmf». La definición moderna no intenta responder cómo se obtienen las funciones de masa de probabilidad; en su lugar, construye una teoría que asume su existencia.

Tratamiento[editar]

La mayoría de las introducciones a la teoría de la probabilidad tratan por separado las distribuciones de probabilidad discretas y las distribuciones de probabilidad continuas. El tratamiento de la probabilidad basado en la teoría de medidas abarca las discretas, las continuas, una mezcla de ambas y más.

Motivación[editar]

Consideremos un experimento que puede producir una serie de resultados. El conjunto de todos los resultados se denomina espacio muestral del experimento. El conjunto de potencias del espacio muestral (o equivalentemente, el espacio de sucesos) se forma considerando todas las colecciones diferentes de resultados posibles. Por ejemplo, lanzar un dado honesto produce uno de seis resultados posibles. Una colección de resultados posibles corresponde a obtener un número impar. Así, el subconjunto {1,3,5} es un elemento del conjunto de potencias del espacio muestral de las tiradas de dados. Estas colecciones se denominan sucesos. En este caso, {1,3,5} es el suceso de que el dado caiga en algún número impar. Si los resultados que realmente ocurren caen en un evento dado, se dice que ese evento ha ocurrido.

La probabilidad es una forma de asignar a cada "suceso" un valor entre cero y uno, con el requisito de que al suceso formado por todos los resultados posibles (en nuestro ejemplo, el suceso {1,2,3,4,5,6}) se le asigne un valor de uno. Para calificar como una distribución de probabilidad, la asignación de valores debe satisfacer el requisito de que si se observa una colección de sucesos mutuamente excluyentes (sucesos que no contienen resultados comunes, por ejemplo, los sucesos {1,6}, {3} y {2,4} son todos mutuamente excluyentes), la probabilidad de que ocurra cualquiera de estos sucesos viene dada por la suma de las probabilidades de los sucesos.[7]

La probabilidad de que ocurra cualquiera de los sucesos {1,6}, {3}, o {2,4} es de 5/6. Esto es lo mismo que decir que la probabilidad del suceso {1,2,3,4,6} es 5/6. Este suceso abarca la posibilidad de que salga cualquier número excepto cinco. El suceso mutuamente excluyente {5} tiene una probabilidad de 1/6, y el suceso {1,2,3,4,5,6} tiene una probabilidad de 1, es decir, certeza absoluta.

Cuando se hacen cálculos utilizando los resultados de un experimento, es necesario que todos esos sucesos elementaless tengan un número asignado. Para ello se utiliza una variable aleatoria. Una variable aleatoria es una función que asigna a cada suceso elemental del espacio muestral un número real. Esta función suele denotarse con una letra mayúscula.[8] En el caso de un dado, la asignación de un número a ciertos sucesos elementales puede hacerse utilizando la función de identidad. Esto no siempre funciona. Por ejemplo, al tirar una moneda los dos resultados posibles son "cara" y "cruz". En este ejemplo, la variable aleatoria X podría asignar al resultado "cara" el número "0" () y al resultado "cruz" el número "1" ().

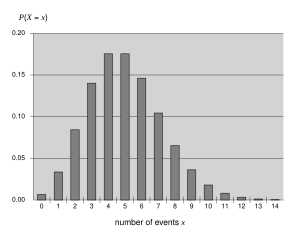

Distribuciones de probabilidad discretas[editar]

Teoría de la probabilidad discreta trata de sucesos que ocurren en espacios muestrales contables.

Ejemplos: Lanzamiento de dados, experimentos con mazos de cartas, paseo aleatorio y lanzamiento de monedas.

Definición clásica: Inicialmente la probabilidad de que ocurra un suceso se definía como el número de casos favorables para el suceso, sobre el número de resultados totales posibles en un espacio muestral equiprobable.

Por ejemplo, si el suceso es "aparición de un número par al lanzar un dado", la probabilidad viene dada por , ya que 3 caras de las 6 tienen números pares y cada cara tiene la misma probabilidad de aparecer.

Variables aleatorias[editar]

Una variable aleatoria es una función medible

que da un valor numérico a cada suceso elemental .

Probabilidad discreta[editar]

Este tipo de probabilidad, es aquel que puede tomar solo ciertos valores diferentes que son el resultado de la cuenta de alguna característica de interés. Más exactamente, un problema de probabilidad discreta es un problema definido por un conjunto de variables aleatorias que solo pueden tomar un conjunto finito o infinito numerable de valores diferentes:

donde:

- designa el cardinal o "número de elementos" de un conjunto.

- , es el conjunto de todos los posibles valores que toma la variable aleatoria.

Probabilidad continua[editar]

Un problema de probabilidad continua es uno en el que aparecen variables aleatorias capaces de tomar valores en algún intervalo de números reales (y por tanto asumir un conjunto no numerable de valores), por lo que continuando con la notación anterior:

Función de distribución de probabilidad[editar]

La distribución de probabilidad se puede definir para cualquier variable aleatoria X, ya sea de tipo continuo o discreto, mediante la siguiente relación:

Para una variable aleatoria discreta esta función no es continua sino constante a tramos (siendo continua por la derecha pero no por la izquierda). Para una variable aleatoria general la función de distribución puede descomponerse en una parte continua y una parte discreta:

Donde es una función absolutamente continua y es una función constante a tramos.

Función de densidad de probabilidad[editar]

La función de densidad, o densidad de probabilidad de una variable aleatoria absolutamente continua, es una función a partir de la cual se obtiene la probabilidad de cada valor que toma la variable definida como:

Es decir, su integral en el caso de variables aleatorias continuas es la distribución de probabilidad. En el caso de variables aleatorias discretas la distribución de probabilidad se obtiene a través del sumatorio de la función de densidad. La noción puede generalizarse a varias variables aleatorias.

Teoría de la probabilidad[editar]

La teoría de la probabilidad moderna incluye temas de las siguientes áreas:

- σ-álgebras, teoría de la medida, medida producto y funciones medibles

- Variables aleatorias y funciones de distribución

- Convergencia de funciones medibles y convergencia débil.

- Independencia probabilística

- Probabilidad condicionada

- Martingalas y tiempos de parada

- Leyes de los grandes números

- Funciones características

- Teorema central del límite y teorema del valor extremo

- Procesos estocásticos

Véase también[editar]

- Distribución de probabilidad

- Epistemología bayesiana

- Estadística

- Interpretaciones de las probabilidades

Referencias[editar]

- ↑ Inferir a partir de datos

- ↑ Lógica cuántica y teoría de la probabilidad. The Stanford Encyclopedia of Philosophy. 10 de agosto de 2021.

- ↑ «"Los orígenes y el legado de los Grundbegriffe de Kolmogorov", por Glenn Shafer y Vladimir Vovk». Consultado el 12 de febrero de 2012.

- ↑ LIGHTNER, JAMES E. (1991). «Una breve mirada a la historia de la probabilidad y la estadística». The Mathematics Teacher 84 (8): 623-630. ISSN 0025-5769. JSTOR 27967334. doi:10.5951/MT.84.8.0623.

- ↑ Grinstead, Charles Miller; James Laurie Snell. «Introduction». Introducción a la probabilidad. pp. vii.

- ↑ Daston, Lorraine J. (1980). «Expectativa probabilística y racionalidad en la teoría clásica de la probabilidad». Historia Mathematica 7 (3): 234-260. doi:10.1016/0315-0860(80)90025-7.

- ↑ Ross, Sheldon (2010). Un primer curso de probabilidad (8th edición). Pearson Prentice Hall. pp. 26-27. ISBN 978-0-13-603313-4. Consultado el 28 de febrero de 2016.

- ↑ Bain, Lee J.; Engelhardt, Max (1992). Introducción a la probabilidad y estadística matemática (2ª edición). Belmont, California: Brooks/Cole. p. 53. ISBN 978-0-534-38020-5.

Bibliografía[editar]

- P. Ibarrola, L. Pardo y V. Quesada (1997): Teoría de la Probabilidad, Ed. Síntesis, ISBN 84-7738-516-5.

- Spiegel, Murray. 1970. Estadística, McGraw-Hill, México.

- Olav Kallenberg, Probabilistic Symmetries and Invariance Principles. Springer-Verlag, New York (2005). 510 pp. ISBN 0-387-25115-4

- Kallenberg, O., Foundations of Modern Probability, 2nd ed. Springer Series in Statistics. (2002). 650 pp. ISBN 0-387-95313-2

Enlaces externos[editar]

Wikimedia Commons alberga una categoría multimedia sobre Teoría de la probabilidad.

Wikimedia Commons alberga una categoría multimedia sobre Teoría de la probabilidad.

![{\displaystyle \mathrm {Prob} (S)=\mu _{P}(S)\in [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/aac632847a29f318934f0d779140735db098a4c1)

![{\displaystyle f(x)\in [0,1]{\mbox{ para todo }}x\in \Omega \,;}](https://wikimedia.org/api/rest_v1/media/math/render/svg/13d01dbcbade4b5d686571928d223dd53470e01d)

![{\displaystyle \mathrm {card} [X(\Omega )]\leq \aleph _{0}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b72a519119da6ba8c372d7bd052c6ac0ea8d4571)

![{\displaystyle \mathrm {card} [\cdot ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cb0baf1b58ac7cb9aa4a3390330b7682b69485b9)

![{\displaystyle \mathrm {card} [X(\Omega )]=\aleph _{1}>\aleph _{0}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/925509a8d533d90585d508a7535134a38f57a07d)