Distribución empírica

En estadística, una función de distribución empírica (comúnmente llamada función de distribución empírica, FDe) es la función de distribución asociada con una medida empírica de una muestra.[1] Esta función de distribución acumulativa es una función escalonada que salta en cada uno de los valores dentro de la muestra empírica. Su valor en cualquier valor especificado de la variable medida es la fracción de observaciones de la variable medida que son menores o iguales al valor especificado.

La función de distribución empírica es una estimación de la función de distribución acumulativa que generó los puntos en la muestra. Esta función, converge con la probabilidad 1 a esa distribución subyacente a cuando , de acuerdo con el teorema de Glivenko-Cantelli. Existen varios resultados para cuantificar la tasa de convergencia de la función de distribución empírica a la función de distribución acumulativa subyacente.

Definición[editar]

Sea sean n variables aleatorias reales independientes e idénticamente distribuidas que se distribuyen según la función de distribución acumulativa . En ese caso, la función de distribución empírica se define como[2][3]

donde es la función indicatriz de eventos . Para un fijo, la función indicatriz es una variable aleatoria de Bernoulli con el parámetro ; por lo tanto, es una variable aleatoria binomial con media y varianza . Esto implica que es un estimador no sesgado para .

Sin embargo, en algunos libros de texto, se define alternativamente como:

Media[editar]

La media de la distribución empírica es un estimador no sesgado de la media de la distribución de la población.

que se denota más comúnmente

Varianza[editar]

La varianza de los tiempos de distribución empírica es un estimador imparcial de la varianza de la distribución poblacional, para cualquier distribución de X que tenga una varianza finita.

Error cuadrático medio[editar]

El error cuadrático medio para la distribución empírica es el siguiente.

Donde es un estimador y un parámetro desconocido.

Cuantiles[editar]

Para cualquier número real la notación (léase "techo de a") denota el entero mínimo mayor o igual que . Para cualquier número real a, la notación (léase "piso de a") denota el entero mayor menor o igual que .

Si no es un entero, entonces el -th quantile es único y es igual a

Si es un entero, entonces el cuantil -th no es único y es cualquier número real tal que

Mediana empírica[editar]

Si es impar, entonces la mediana empírica es el número

Si es par, entonces la mediana empírica es el número

Propiedades asintóticas[editar]

Dado que la relación se acerca a uno a medida que tiende a infinito, las propiedades asintóticas de las dos definiciones que se dan arriba son las mismas. Además, por la ley fuerte de los números grandes, el estimador converge a cuando casi con seguridad, para cada valor de :[2]

por lo tanto, el estimador es consistente. Esta expresión establece que hay convergencia puntual de la función de distribución empírica a la verdadera función de distribución acumulativa. Un resultado más lógicamente fuerte, llamado el teorema de Glivenko-Cantelli, establece que la convergencia de hecho ocurre uniformemente sobre t:[6]

La norma del suprmeo en esta expresión se llama estadística de Kolmogorov–Smirnov para la bondad del ajuste entre la distribución empírica y la verdadera función de distribución acumulativa asumida . Puedne usarse otras normas como, por ejemplo, la norma L2, lo que da lugar a la estadística de Cramér-von Mises.

La distribución asintótica se puede caracterizar de varias maneras diferentes. En primer lugar, el teorema del límite central establece que pointwise, tiene una distribución asintóticamente normal con el estándar tasa de convergencia:[2] {{ecuación|

||left}

Este resultado se extiende por el teorema de Donsker, que afirma que el proceso empírico , visto como una función indexada por , converge en distribución en el espacio de Skorokhod al medio-cero proceso gaussiano , donde B es el puente Browniano estándar.[6] La estructura de covarianza de este proceso gaussiano es

La tasa uniforme de convergencia en el teorema de Donsker se puede cuantificar por el resultado conocido como incrustación húngara:[7]

Alternativamente, la tasa de convergencia de también se puede cuantificar en términos del comportamiento asintótico de la suposición de esta expresión. El número de resultados existen en este lugar, por ejemplo, la desigualdad de Dvoretzky–Kiefer–Wolfowitz proporciona probabilidades limitadas en la cola de :[7]

De hecho, Kolmogorov demostró que si la función de distribución acumulativa es continua, entonces la expresión converge en distribución a , que tiene la distribución de Kolmogorov que no depende de la forma de .

Otro resultado, que se desprende de la ley del logaritmo iterado, es que[7]

y

Intervalos de confianza[editar]

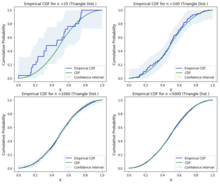

Según desigualdad de Dvoretzky-Kiefer-Wolfowitz el intervalo que contiene el verdadero CDF, , con probabilidad se especifica como

De acuerdo con los límites anteriores, podemos trazar los intervalos empíricos CDF, CDF y Confidence para diferentes distribuciones utilizando cualquiera de las implementaciones estadísticas. A continuación se muestra la sintaxis de Statsmodel para trazar la distribución empírica.

Implementación estadística[editar]

Una lista no exhaustiva de implementaciones de software de la función de distribución empírica es la siguiente:

- En R software, calculamos una función empírica de distribución acumulativa, con varios métodos para trazar, imprimir y calcular con un objeto "ecdf".

- En MATLAB podemos utilizar la gráfica de la función de distribución acumulativa empírica (cdf)

- jmp de SAS, la gráfica CDF crea una gráfica de la función empírica de distribución acumulativa.

- Minitab, crear un CDF empírico

- Mathwave, podemos ajustar la distribución de probabilidad a nuestros datos

- Dataplot, podemos trazar la gráfica empírica de CDF

- Scipy Archivado el 24 de octubre de 2021 en Wayback Machine., usando scipy.stats podemos trazar la distribución

- Statsmodels, podemos usar statsmodels.distributions.empirical_distribution. ECDF

- Matplotlib, podemos usar histogramas para trazar una distribución acumulativa

- Seaborn, utilizando la función seaborn.ecdfplot

- Plotly, usando la función plotly.express.ecdf

- Excel, podemos trazar la gráfica empírica de CDF

Referencias[editar]

- ↑ A modern introduction to probability and statistics: understanding why and how. Michel Dekking. London: Springer. 2005. p. 219. ISBN 978-1-85233-896-1. OCLC 262680588.

- ↑ a b c van der Vaart, A.W. (1998). Asymptotic statistics. Cambridge University Press. p. 265. ISBN 0-521-78450-6.

- ↑ «PlanetMath». Archivado desde el original el 9 de mayo de 2013. Consultado el 7 de octubre de 2022.

- ↑ Coles, S. (2001) An Introduction to Statistical Modeling of Extreme Values. Springer, p. 36, Definición 2.4. ISBN 978-1-4471-3675-0.

- ↑ Madsen, H.O., Krenk, S., Lind, S.C. (2006) Métodos de seguridad estructural. Publicaciones Dover. págs. 148-149. ISBN 0486445976

- ↑ a b van der Vaart, A.W. (1998). Asymptotic statistics. Cambridge University Press. p. 266. ISBN 0-521-78450-6.

- ↑ a b c van der Vaart, A.W. (1998). Asymptotic statistics. Cambridge University Press. p. 268. ISBN 0-521-78450-6.

Bibliografía[editar]

- Shorack, G.R.; Wellner, J.A. (1986). Empirical Processes with Applications to Statistics. New York: Wiley. ISBN 0-471-86725-X.

![{\displaystyle {\begin{aligned}\operatorname {Var} (X)&=\operatorname {E} \left[(X-\operatorname {E} [X])^{2}\right]\\[4pt]&=\operatorname {E} \left[(X-{\bar {x}})^{2}\right]\\[4pt]&={\frac {1}{n}}\left(\sum _{i=1}^{n}{(x_{i}-{\bar {x}})^{2}}\right)\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/856a9443ed6145aee944520e94efa625bfadd3bd)

![{\displaystyle {\begin{aligned}\operatorname {MSE} &={\frac {1}{n}}\sum _{i=1}^{n}(Y_{i}-{\hat {Y_{i}}})^{2}\\[4pt]&=\operatorname {Var} _{\hat {\theta }}({\hat {\theta }})+\operatorname {Bias} ({\hat {\theta }},\theta )^{2}\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2928ea7b7ebfcad86439fae9b35ad4f576eaabfe)

![{\displaystyle \scriptstyle D[-\infty ,+\infty ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3215d9f75e16a202f9c838f5664d27e250e93b9b)

![{\displaystyle \operatorname {E} [\,G_{F}(t_{1})G_{F}(t_{2})\,]=F(t_{1}\wedge t_{2})-F(t_{1})F(t_{2})}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c993f9968ec880f9c05b3c2eb14606cbbe4ee172)