CUDA

| CUDA | ||

|---|---|---|

| Información general | ||

| Tipo de programa | GPGPU | |

| Desarrollador | NVIDIA Corporation | |

| Lanzamiento inicial | 23 de junio de 2007 | |

| Licencia | Propietaria, Freeware | |

| Versiones | ||

| Última versión estable | 9.1 ( 12 de diciembre de 2017 (6 años, 4 meses y 24 días)) | |

| Enlaces | ||

CUDA son las siglas de Compute Unified Device Architecture (Arquitectura Unificada de Dispositivos de Cómputo) que hace referencia a una plataforma de computación en paralelo incluyendo un compilador y un conjunto de herramientas de desarrollo creadas por nVidia que permiten a los programadores usar una variación del lenguaje de programación C para codificar algoritmos en GPU de nVidia.

Por medio de wrappers se puede usar Python, Fortran y Java en vez de C/C++.

Funciona en todas las GPU nVidia de la serie G8X en adelante, incluyendo GeForce, Quadro, ION y la línea Tesla.[1] nVidia afirma que los programas desarrollados para la serie GeForce 8 también funcionarán sin modificaciones en todas las futuras tarjetas nVidia, gracias a la compatibilidad binaria.

CUDA intenta explotar las ventajas de las GPU frente a las CPU de propósito general utilizando el paralelismo que ofrecen sus múltiples núcleos, que permiten el lanzamiento de un altísimo número de hilos simultáneos. Por ello, si una aplicación está diseñada utilizando numerosos hilos que realizan tareas independientes (que es lo que hacen las GPU al procesar gráficos, su tarea natural), una GPU podrá ofrecer un gran rendimiento en campos que podrían ir desde la biología computacional a la criptografía, por ejemplo.

El primer SDK se publicó en febrero de 2007 en un principio para Windows, Linux, y más adelante en su versión 2.0 para Mac OS. Actualmente se ofrece para Windows XP/Vista/7/8/10[2], para Linux 32/64 bits[3] y para macOS[4].

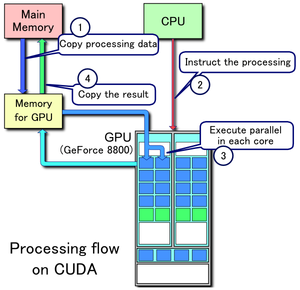

1. Se copian los datos de la memoria principal a la memoria de la GPU

2. La CPU encarga el proceso a la GPU

3. La GPU lo ejecuta en paralelo en cada núcleo

4. Se copia el resultado de la memoria de la GPU a la memoria principal

Ventajas

CUDA presenta ciertas ventajas sobre otros tipos de computación sobre GPU utilizando APIs gráficas.

- Lecturas dispersas: se puede consultar cualquier posición de memoria.

- Memoria compartida: CUDA pone a disposición del programador un área de memoria de 16KB (o 48KB en la serie Fermi) que se compartirá entre hilos. Dado su tamaño y rapidez puede ser utilizada como caché.

- Lecturas más rápidas de y hacia la GPU.

- Soporte para enteros y operadores a nivel de bit.

Limitaciones

- No se puede utilizar recursividad, punteros a funciones, variables estáticas dentro de funciones o funciones con número de parámetros variable

- No está soportado el renderizado de texturas

- En precisión simple no soporta números desnormalizados o NaNs

- Puede existir un Cuello de botella entre la CPU y la GPU por los anchos de banda de los buses y sus latencias.

- Los threads o Hilo de ejecución, por razones de eficiencia, deben lanzarse en grupos de al menos 32, con miles de hilos en total.

El modelo CUDA

CUDA intenta aprovechar el gran paralelismo, y el alto ancho de banda de la memoria en las GPU en aplicaciones con un gran coste aritmético frente a realizar numerosos accesos a memoria principal, lo que podría actuar de cuello de botella.

El modelo de programación de CUDA está diseñado para que se creen aplicaciones que de forma transparente escalen su paralelismo para poder incrementar el número de núcleos computacionales. Este diseño contiene tres puntos claves, que son la jerarquía de grupos de hilos, las memorias compartidas y las barreras de sincronización.

La estructura que se utiliza en este modelo está definido por un grid, dentro del cual hay bloques de hilos que están formados por como máximo 512 hilos distintos.

Cada hilo está identificado con un identificador único, que se accede con la variable threadIdx. Esta variable es muy útil para repartir el trabajo entre distintos hilos. threadIdx tiene 3 componentes (x, y, z), coincidiendo con las dimensiones de bloques de hilos. Así, cada elemento de una matriz, por ejemplo, lo podría tratar su homólogo en un bloque de hilos de dos dimensiones.

Al igual que los hilos, los bloques se identifican mediante blockIdx (en este caso con dos componentes x e y). Otro parámetro útil es blockDim, para acceder al tamaño de bloque.

Kernel

Un kernel en “C for CUDA”, es una función la cual al ejecutarse lo hará en N distintos hilos en lugar de en secuencial. Se define incluyendo __global__ en la declaración. Por ejemplo:

//Definición del kernel

__global__ void f(int a, int b, int c)

{

}

Si nuestra función f queremos que calcule la diferencia entre dos vectores A y B y lo almacene en un tercero C:

__global__ void f(int* A, int* B, int* C)

{

int i = threadIdx.x;

C[i] = A[i] - B[i];

}

Esta función se ejecutaría una vez en cada hilo, reduciendo el tiempo total de ejecución en gran medida, y dividiendo su complejidad, O(n), por una constante directamente relacionada con el número de procesadores disponibles.

El mismo ejemplo con matrices sería:

__global__ void f(int** A, int** B, int** C)

{

int i = threadIdx.x; //Columna del bloque que ocupa este determinado hilo

int j= threadIdx.y; //Fila

C[i][j] = A[i][j] - B[i][j];

}

Invocaciones a un kernel

En una llamada a un kernel, se le ha de pasar el tamaño de grid y de bloque, por ejemplo, en el main del ejemplo anterior podríamos añadir:

dim3 bloque(N,N); //Definimos un bloque de hilos de N*N

dim3 grid(M,M) //Grid de tamaño M*M

f<<<grid, bloque>>>(A, B, C);

En el momento que se invoque esta función, los bloques de un grid se enumerarán y distribuirán por los distintos multiprocesadores libres.

Sincronización

Como los distintos hilos colaboran entre ellos y pueden compartir datos, se requieren unas directivas de sincronización. En un kernel, se puede explicitar una barrera incluyendo una llamada a __syncthreads(), en la que todos los hilos se esperarán a que los demás lleguen a ese mismo punto.

Jerarquía de memoria

Los hilos en CUDA pueden acceder a distintas memorias, unas compartidas y otras no.

- En primer lugar, está la memoria privada de cada hilo, solamente accesible desde él mismo.

- Cada bloque de hilos posee también un espacio de memoria, compartida en este caso por los hilos del bloque y con un ámbito de vida igual que el del propio bloque.

- Todos los hilos pueden acceder a una memoria global.

Además, existen otros dos espacios de memoria más, que son de solo lectura y accesibles por todos los hilos. Son la memoria constante y la de texturas. Todas las memorias de acceso global persisten mientras esté el kernel en ejecución.

Arquitectura CUDA

Un multiprocesador contiene ocho procesadores escalares, dos unidades especiales para funciones trascendentales, una unidad multihilo de instrucciones y una memoria compartida. El multiprocesador crea y maneja los hilos sin ningún tipo de overhead por la planificación, lo cual unido a una rápida sincronización por barreras y una creación de hilos muy ligera, consigue que se pueda utilizar CUDA en problemas de muy baja granularidad, incluso asignando un hilo a un elemento por ejemplo de una imagen (un píxel).

Tarjetas Soportadas

Lista completa, con la versión soportada de CUDA: https://developer.nvidia.com/cuda-gpus

|

Referencias

- ↑ «Productos aptos para CUDA - NVIDIA».

- ↑ «CUDA Installation Guide for Microsoft Windows». docs.nvidia.com (en inglés estadounidense). Consultado el 9 de junio de 2019.

- ↑ «NVIDIA CUDA Installation Guide for Linux». docs.nvidia.com (en inglés estadounidense). Consultado el 9 de junio de 2019.

- ↑ «NVIDIA CUDA Installation Guide for Mac OS X». docs.nvidia.com (en inglés estadounidense). Consultado el 9 de junio de 2019.